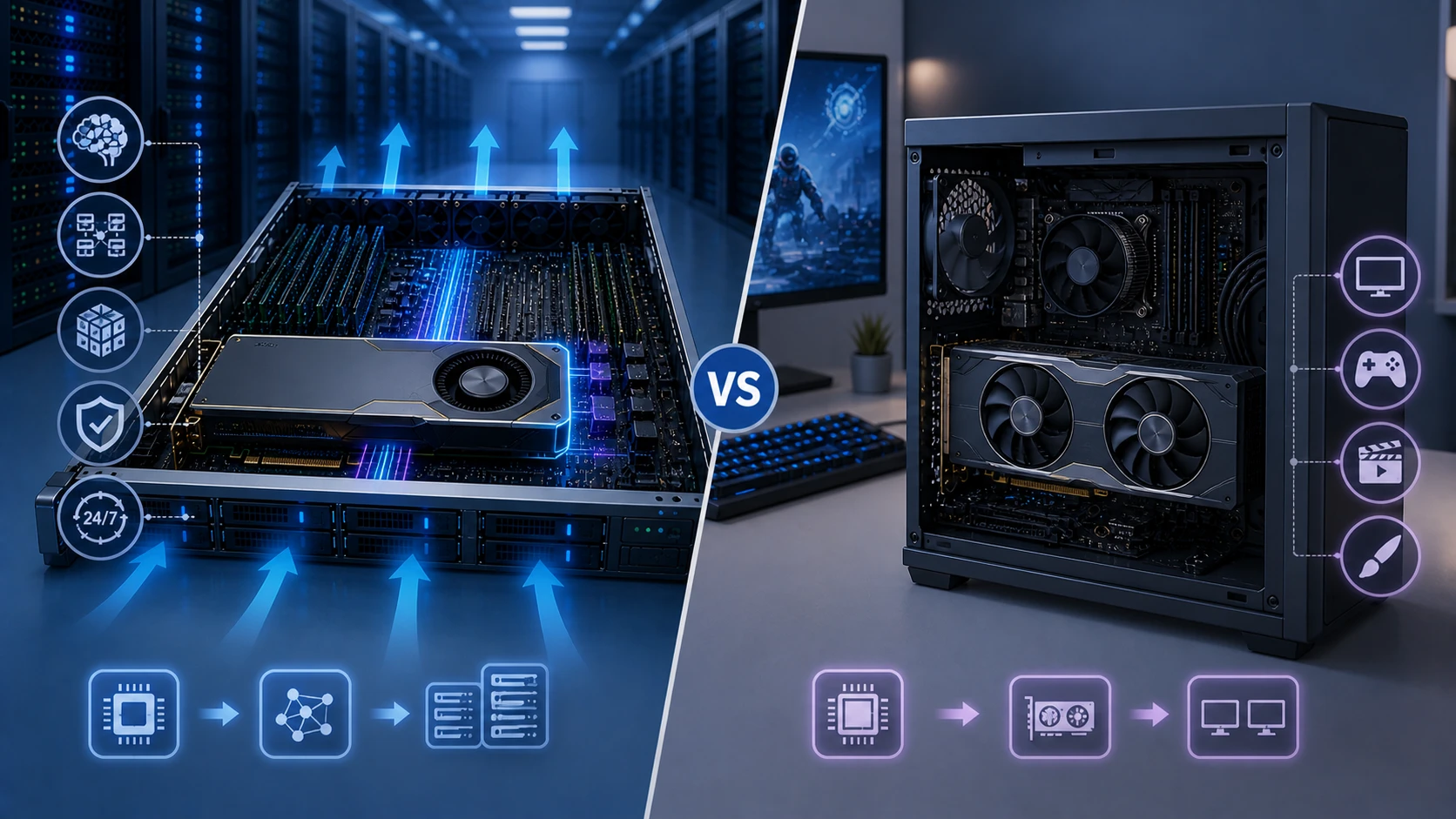

Eine normale Grafikkarte und eine Server-Grafikkarte basieren auf demselben Grundprinzip: Beide nutzen eine GPU, also einen Grafikprozessor, um viele Rechenoperationen parallel auszuführen. Trotzdem sind sie für sehr unterschiedliche Einsatzbereiche entwickelt. Eine Desktop-Grafikkarte ist vor allem für Bildausgabe, Gaming, kreative Anwendungen oder einzelne Workstations gedacht. Eine Server-Grafikkarte wird dagegen meist als Rechenbeschleuniger für KI, Virtualisierung, Rendering, Simulationen oder professionelle Datenverarbeitung eingesetzt.

Wer einen Server mit GPU plant oder über einen hpe server konfigurator eine passende Plattform zusammenstellt, sollte deshalb nicht nur auf die reine Rechenleistung achten. Entscheidend sind auch Kühlung, Stromversorgung, Speichergröße, Treiber, Virtualisierungsfunktionen, Plattformkompatibilität und der geplante Dauerbetrieb. Eine starke Consumer-GPU ist nicht automatisch die richtige Wahl für einen produktiven Server.

Der wichtigste Unterschied liegt im Einsatzzweck

Eine gewöhnliche Grafikkarte ist für lokale Nutzer optimiert. Sie rendert Spiele, beschleunigt Videoschnitt, unterstützt 3D-Anwendungen oder sorgt für mehrere Monitore. Dabei stehen Bildausgabe, hohe Taktraten, kurze Lastspitzen und ein gutes Preis-Leistungs-Verhältnis im Vordergrund.

Eine Server-GPU verfolgt ein anderes Ziel. Sie soll Workloads in einer professionellen Umgebung beschleunigen: KI-Training, KI-Inferenz, virtuelle Desktops, CAD per VDI, Video-Transcoding, wissenschaftliche Berechnungen, Datenanalyse oder Rendering-Farmen. Häufig arbeitet sie ohne direkt angeschlossenen Monitor. Ihre wichtigste Aufgabe ist nicht die Anzeige eines Bildes, sondern parallele Rechenleistung unter kontrollierter Dauerlast.

Server-GPUs sind für Dauerlast und Rechenzentren gebaut

Desktop-Grafikkarten laufen oft mit wechselnder Last: mal Gaming, mal Leerlauf, mal ein kurzer Renderjob. Server-GPUs werden dagegen für lange, gleichmäßige und oft sehr hohe Auslastung eingesetzt. In KI- oder HPC-Umgebungen können Beschleuniger über viele Stunden oder Tage hinweg nahezu dauerhaft arbeiten.

Deshalb spielen Stabilität, thermisches Verhalten und Validierung eine größere Rolle als bei Consumer-Karten. Eine Server-GPU muss in ein konkretes Servergehäuse passen, vom Luftstrom unterstützt werden, mit der Stromversorgung kompatibel sein und vom Hersteller für bestimmte Plattformen freigegeben sein. Besonders bei 1U- oder 2U-Servern ist die Kühlung ein kritischer Punkt.

Kühlung: passiv statt aktiv

Ein sichtbarer Unterschied ist die Kühlung. Viele normale Grafikkarten besitzen eigene Lüfter. Sie sind für Desktop-Gehäuse ausgelegt, in denen die Karte ihre Wärme selbst aktiv abführt. Server-GPUs sind dagegen häufig passiv gekühlt. Sie haben also keinen eigenen großen Lüfter, sondern werden durch den starken, gerichteten Luftstrom des Servers gekühlt.

Das ist effizient, funktioniert aber nur in dafür geeigneten Systemen. Eine passive Server-GPU in ein ungeeignetes Gehäuse einzubauen, kann schnell zu Überhitzung führen. Umgekehrt passt eine große Gaming-Grafikkarte mit offenem Kühlerdesign oft schlecht in dichte Rack-Server, weil Luftführung, Platzbedarf und Stromanschlüsse nicht zur Serverplattform passen.

Speicher: VRAM, ECC und große Datenmengen

Server-GPUs verfügen oft über besonders viel Grafikspeicher. Das ist wichtig, weil KI-Modelle, 3D-Szenen, Simulationsdaten oder große Batch-Verarbeitungen direkt im GPU-Speicher gehalten werden müssen. Bei vielen professionellen Workloads ist nicht nur die Rechenleistung entscheidend, sondern auch die Größe und Bandbreite des Speichers.

Ein weiterer Punkt ist die Fehlerresistenz. Im professionellen Umfeld können Speicherfehler ernsthafte Folgen haben, etwa falsche Berechnungsergebnisse oder instabile Workloads. Deshalb bieten viele Server- und Workstation-GPUs Funktionen, die stärker auf Datenintegrität und zuverlässigen Betrieb ausgerichtet sind als typische Consumer-Modelle.

Treiber, Software und Virtualisierung

Ein großer Unterschied liegt in der Softwareunterstützung. Server-GPUs werden häufig mit professionellen Treibern, langfristigem Support und Funktionen für Virtualisierung eingesetzt. Das ist besonders wichtig bei VDI, Multi-User-Umgebungen, KI-Plattformen oder gemeinsam genutzten GPU-Ressourcen.

Bei virtuellen Desktops oder geteilten Rechenumgebungen kann GPU-Leistung mehreren Nutzern oder virtuellen Maschinen zugewiesen werden. Dafür braucht es passende Hardware, Treiber, Hypervisor-Unterstützung und oft auch spezielle Lizenzen. Eine normale Desktop-Grafikkarte ist dafür meist nicht ideal, selbst wenn ihre Rohleistung hoch ist.

Display-Ausgänge sind oft zweitrangig

Viele Consumer-Grafikkarten besitzen mehrere HDMI- oder DisplayPort-Ausgänge. Das ist logisch, weil sie Monitore ansteuern sollen. Bei Server-GPUs ist die Situation anders. Manche Modelle haben gar keine klassischen Display-Ausgänge oder diese spielen nur eine Nebenrolle.

In einem Server wird die Anzeige häufig über Remote-Management, virtuelle Konsolen oder Netzwerkprotokolle bereitgestellt. Die GPU dient dann primär als Beschleuniger für Berechnungen, VDI-Sessions oder Grafik-Workloads, nicht als klassische Grafikausgabe für einen lokalen Bildschirm.

Plattformkompatibilität und Zertifizierung

Bei Desktop-PCs prüfen Nutzer meist, ob die Karte mechanisch passt und das Netzteil genug Leistung bietet. Bei Servern reicht das nicht aus. Hier muss geklärt werden, ob die GPU vom Servermodell unterstützt wird, ob passende Riser-Karten vorhanden sind, ob die PCIe-Lanes ausreichen, ob die Kühlung freigegeben ist und ob Firmware sowie Betriebssystem kompatibel sind.

Gerade bei HPE-, Dell- oder Lenovo-Servern ist es sinnvoll, nur validierte GPU-Konfigurationen zu verwenden. Das reduziert Risiken bei Stabilität, Support und Wartung. Eine nicht freigegebene Consumer-GPU kann zwar unter Umständen funktionieren, ist aber in produktiven Umgebungen schwerer zuverlässig zu betreiben.

Preis und Wirtschaftlichkeit

Server-GPUs sind häufig deutlich teurer als normale Grafikkarten. Der Preis ergibt sich nicht nur aus der Rechenleistung, sondern aus Speichergröße, Validierung, professionellem Support, Treiberfunktionen, Dauerlastfähigkeit und Einsatz in Rechenzentren.

Das bedeutet aber nicht, dass immer eine Server-GPU nötig ist. Für ein Testsystem, eine einzelne Workstation oder gelegentliche Grafikaufgaben kann eine normale GPU ausreichend sein. Für produktive KI, VDI, HPC, Rendering oder geschäftskritische GPU-Workloads ist eine echte Server-GPU jedoch meist die stabilere und langfristig sinnvollere Wahl.

Wann ist welche GPU sinnvoll?

- Normale Grafikkarte: Gaming, lokale Workstation, Videoschnitt, einzelne 3D-Anwendungen, Testumgebungen.

- Workstation-GPU: CAD, professionelle Grafik, Rendering, zertifizierte Kreativ- und Engineering-Software.

- Server-GPU: KI, Inferenz, VDI, HPC, Simulation, Video-Transcoding, Rendering-Farmen und Multi-User-Umgebungen.

Fazit

Eine Server-Grafikkarte unterscheidet sich von einer normalen Grafikkarte nicht nur durch Preis oder Leistung. Sie ist für professionelle Workloads, Dauerbetrieb, hohe Datenmengen, zuverlässige Kühlung, validierte Plattformen und oft auch Virtualisierung ausgelegt. Eine Consumer-GPU ist dagegen primär für lokale Nutzung, Bildausgabe und einzelne Anwender optimiert.

Die richtige Wahl hängt vom Einsatzszenario ab. Wer einen Server nur für klassische Dienste wie Dateien, Webanwendungen oder kleinere Datenbanken nutzt, braucht meist keine starke GPU. Wer jedoch KI, virtuelle Arbeitsplätze, Rendering, Simulationen oder GPU-beschleunigte Analysen betreibt, sollte auf eine passende Server-GPU und eine dafür validierte Plattform achten.